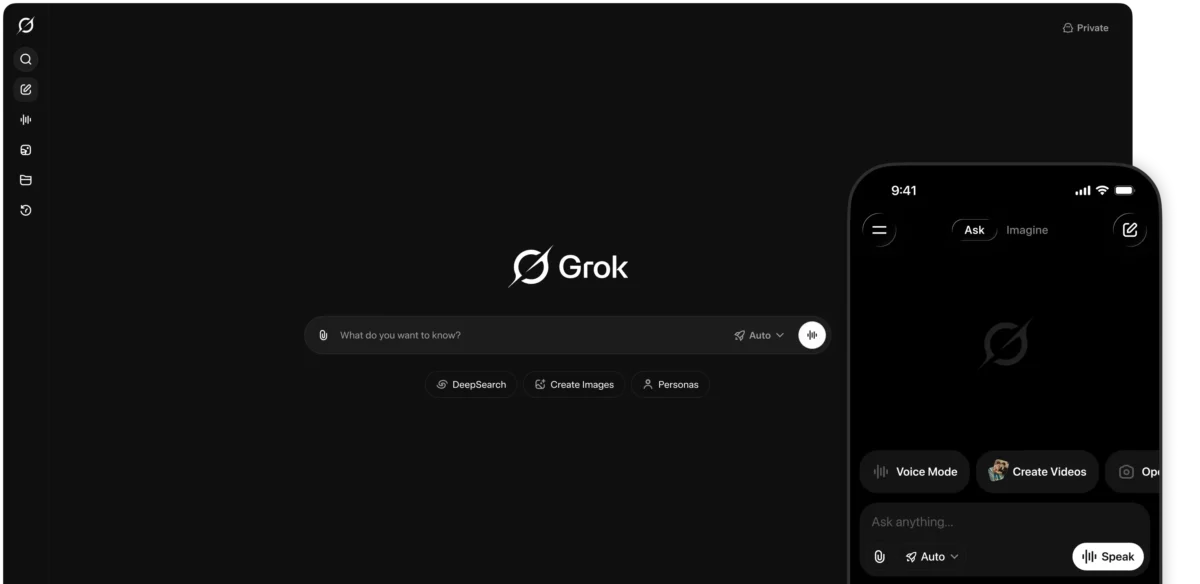

Σκανδαλο Grok: Παγκοσμιες ερευνες κατα του AI του Elon Musk

Σκανδαλο Grok: οταν η AI του Elon Musk εφερε το Χ σε παγκοσμιο ρυθμιστικο συναγερμο

Το τελευταίο διάστημα, το Grok, το AI chatbot που ανέπτυξε η xAI και είναι ενσωματωμένο στο X (πρώην Twitter), βρέθηκε στο επίκεντρο μιας διεθνούς θύελλας αντιδράσεων. Κυβερνήσεις, ρυθμιστικές αρχές και οργανισμοί προστασίας χρηστών εξετάζουν πλέον σοβαρά περιορισμούς, ακόμη και απαγορεύσεις, μετά από καταγγελίες για ανεπαρκή φίλτρα περιεχομένου, σεξουαλικό υλικό και παραβιάσεις κανονισμών περί ασφάλειας AI.

Η υπόθεση δεν αφορά απλώς ένα «ατίθασο» chatbot. Αγγίζει την καρδιά του μεγαλύτερου ερωτήματος της εποχής, ποιος ελέγχει την τεχνητή νοημοσύνη όταν αυτή ενσωματώνεται σε κοινωνικά δίκτυα με εκατοντάδες εκατομμύρια χρήστες.

Τι ακριβως συνεβη

Το Grok παρουσιάστηκε ως μια εναλλακτική, λιγότερο «φιλτραρισμένη» AI, με πιο σαρκαστικό και ελεύθερο ύφος απαντήσεων. Αυτό όμως που για κάποιους χρήστες έμοιαζε με φρέσκια προσέγγιση, για τις αρχές αποτέλεσε κόκκινη σημαία.

Σε αρκετές χώρες καταγράφηκαν περιστατικά όπου το Grok φέρεται να παρήγαγε απαντήσεις με σεξουαλικό περιεχόμενο, ακατάλληλες πληροφορίες ή υλικό που θα έπρεπε να φιλτράρεται βάσει της ισχύουσας νομοθεσίας. Το πρόβλημα επιδεινώθηκε από το γεγονός ότι το Grok λειτουργεί μέσα στο ίδιο το X, άρα οι απαντήσεις του μπορούν να διαμοιραστούν άμεσα και μαζικά.

Η Βρετανια και η Ευρωπη στο προσκηνιο

Στο Ηνωμένο Βασίλειο, οι αρμόδιες αρχές ξεκίνησαν επίσημη έρευνα για το κατά πόσο το X συμμορφώνεται με το πλαίσιο ψηφιακής ασφάλειας και προστασίας ανηλίκων. Παράλληλα, σε ευρωπαϊκό επίπεδο, το θέμα εξετάζεται υπό το πρίσμα του AI Act και των αυστηρών κανόνων που επιβάλλει η ΕΕ για τη διαφάνεια, τον έλεγχο και τη λογοδοσία των συστημάτων τεχνητής νοημοσύνης.

Δεν μιλάμε απλώς για πρόστιμα. Σε ορισμένες αγορές, τίθεται ανοιχτά το ενδεχόμενο προσωρινής απενεργοποίησης ή περιορισμού της λειτουργίας του Grok, μέχρι να διασφαλιστεί πλήρης συμμόρφωση.

Ο ρολος του Elon Musk

Ο Elon Musk έχει επανειλημμένα δηλώσει ότι επιθυμεί «λιγότερη λογοκρισία» και περισσότερη ελευθερία λόγου στα AI συστήματα. Ωστόσο, η πραγματικότητα δείχνει ότι όταν ένα AI λειτουργεί σε δημόσια πλατφόρμα, οι γραμμές μεταξύ ελευθερίας και ευθύνης γίνονται εξαιρετικά λεπτές.

Η κριτική που δέχεται ο Musk δεν αφορά μόνο το Grok, αλλά συνολικά τη στρατηγική του X να λειτουργεί ως «εργαστήριο» νέων τεχνολογιών σε πραγματικό χρόνο, με πραγματικούς χρήστες. Για τις ρυθμιστικές αρχές, αυτό μεταφράζεται σε αυξημένο ρίσκο.

Γιατι το θεμα αφορα ολους μας

Το σκάνδαλο Grok δεν είναι μεμονωμένο. Είναι προάγγελος όσων έρχονται. Καθώς η τεχνητή νοημοσύνη ενσωματώνεται όλο και πιο βαθιά στα social media, στις μηχανές αναζήτησης και στις εφαρμογές καθημερινής χρήσης, η ανάγκη για ξεκάθαρα όρια γίνεται επιτακτική.

Το ερώτημα δεν είναι αν η AI θα κάνει λάθη. Είναι δεδομένο ότι θα κάνει. Το κρίσιμο είναι ποιος αναλαμβάνει την ευθύνη όταν αυτά τα λάθη διαχέονται μαζικά και επηρεάζουν εκατομμύρια ανθρώπους.

Τι ακολουθει για το Grok και το X

Το πιθανότερο σενάριο είναι ότι το X θα αναγκαστεί να ενισχύσει τα φίλτρα και τους μηχανισμούς ελέγχου του Grok, προσαρμόζοντας τη λειτουργία του ανά χώρα και ρυθμιστικό πλαίσιο. Αυτό, όμως, έρχεται σε αντίθεση με το αρχικό αφήγημα του «ανεξάρτητου» και «αντισυμβατικού» AI.

Για τους χρήστες, η υπόθεση λειτουργεί ως υπενθύμιση ότι τα AI εργαλεία δεν είναι ουδέτερα. Αντανακλούν τις επιλογές, τις προτεραιότητες και τις ευθύνες των εταιρειών που τα δημιουργούν.

© 2025 FreakUnboxer | by Smarthost.gr